AI科技讓人類的生活更加便利,卻也成了性暴力犯罪的幫兇。日前知名網紅涉嫌利用AI換臉軟體「Deepfake」,將知名人物臉部圖像移植到成人影片並非法牟利,檢方訊後諭令以新臺幣50萬元交保。

性羞辱是傷害他人最快速的作法。類似Deepfake的數位性暴力犯罪像瘟疫似的透過網路蔓延,加害人利用AI科技,忽略他人對性的厭惡或羞恥感,一鍵粗暴地將被害人的衣著扒光,合成裸照或私密影片,滿足所有消費使用者窺視意淫的慾望。

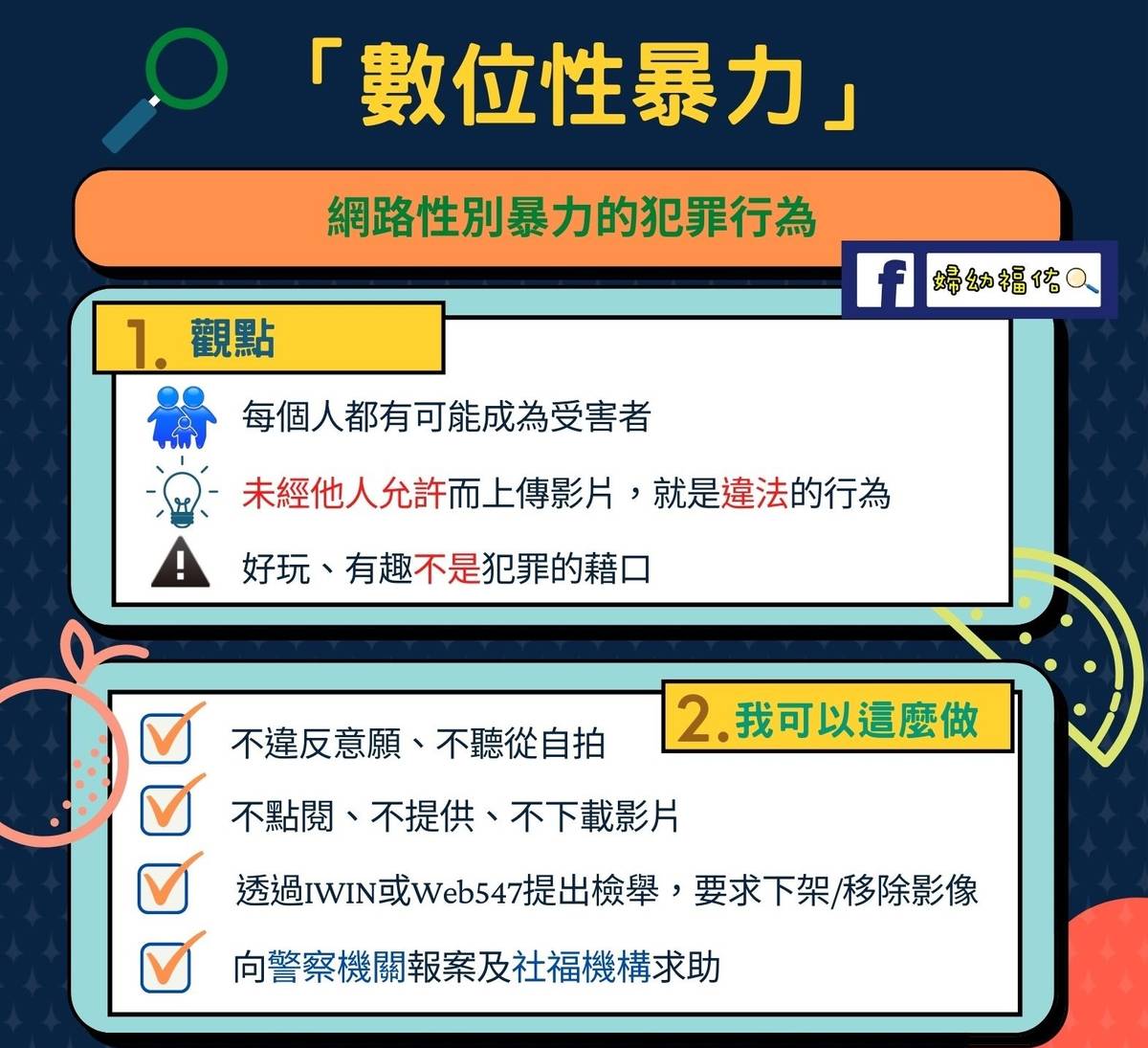

面對數位性暴力犯罪(如Deepfake),青少年族群與一般民眾應如何防範自保?臺北市警察局婦幼警察隊提出幾項建議,包括從校園落實性平教育和宣導法治教育,提升校內師生數位性暴力的認知,培養安全意識並協助預防風險。此外,不拍攝或傳送私密、裸露的視訊及照片給他人,不輕易加入好友連結,隱匿網路平台資訊,避免洩漏個資。

青少年一旦遇到數位性暴力犯罪,請先將頁面截圖,儲存網址,紀錄截圖的時間,發文者的帳號、暱稱、聯絡資訊。通報師長及向警政機關報案,利用「Web547檢舉熱線」、「IWIN」網站提出檢舉,要求下架或移除影像。

最後,警方也提醒,科技始終來自於人性,未經本人同意而傳遞的「Deepfake」影片,其實就是犯罪行為,透過網路變相散播假訊息,導致被害人長期遭受「數位烙印」而備受折磨,「不點閱、不下載、不分享」就是對被害者最好的幫助。